tg-me.com/machinelearning_interview/1820

Last Update:

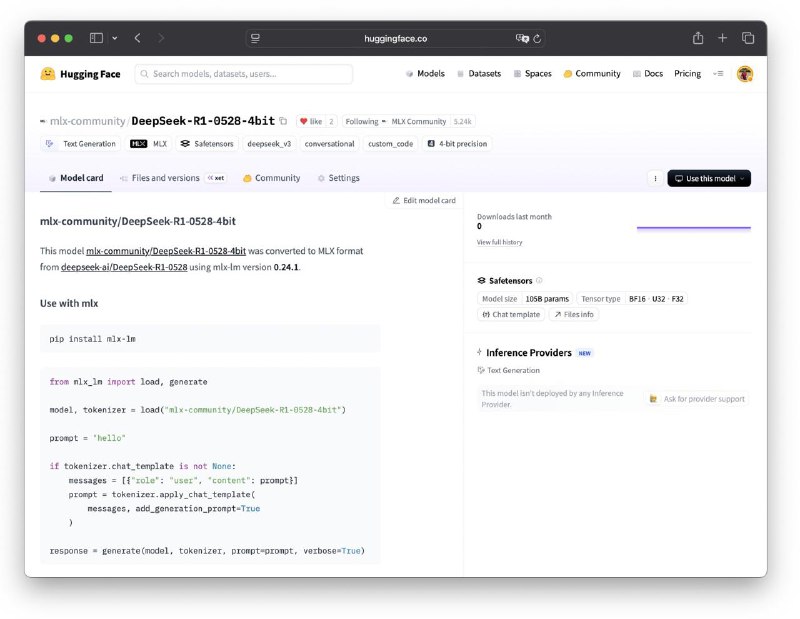

🔥 DeepSeek R1 (0528) — компактная MLX-версия!

А вот и 4-битная квантованная версия DeepSeek R1 специально под MLX.

Модель запускается локально на Mac с Apple Silicon без танцев с бубном и GPU.

Установка:pip install mlx-lmfrom mlx_lm import load, generate

model, tokenizer = load("mlx-community/DeepSeek-R1-0528-4bit")

prompt = "hello"

if tokenizer.chat_template is not None:

messages = [{"role": "user", "content": prompt}]

prompt = tokenizer.apply_chat_template(

messages, add_generation_prompt=True

)

response = generate(model, tokenizer, prompt=prompt, verbose=True)

👉 huggingface.co/mlx-community/DeepSeek-R1-0528-4bit

#DeepSeek

BY Machine learning Interview

Share with your friend now:

tg-me.com/machinelearning_interview/1820